炒股就看金麒麟分析师研报,泰斗,专科,实时,全面,助您挖掘后劲主题契机!

开始:XG云数智

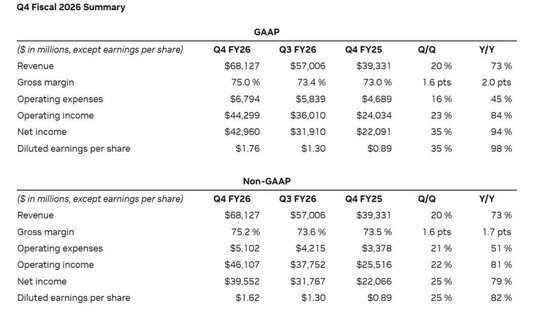

英伟达本日公布了第四财季事迹,进展超预期。在限制1 月 25 日的第四财季,英伟达营收681 亿好意思元,阛阓预期为656.84 亿好意思元,上年同期为 393.31 亿好意思元,同比增长73%。净利润险些翻倍,从旧年同期的221 亿好意思元(每股 0.89 好意思元)增至 430 亿好意思元(每股 1.76 好意思元)。

其中,数据中心营收为623 亿好意思元,阛阓预期为 606.2 亿好意思元,上年同期为 355.8 亿好意思元,同比增长 75%。

曾是英伟达最伟业务的游戏部门,当季营收同比增长47%,至 37 亿好意思元,但环比着落 13%,且低于阛阓预期的 40.1 亿好意思元。汽车有关销售额为 6.04 亿好意思元,华尔街预期为 6.43 亿好意思元。

从全年进展看,2026财年总营收达2159亿好意思元,同比增长65%;净利润1200亿好意思元,每股摊薄收益4.90好意思元,同比增长67%。

英伟达展望2027财年第一财季营收为780亿好意思元,高于分析师渊博预期的726亿好意思元。

英伟达显露,其预测未计入来自中国的数据中心收入。英伟达炫夸,本月已获取好意思国许可,可向中国客户出货‘一丝’H200 芯片。

在事迹讲明会上,英伟达CEO黄仁勋强调,尽管阛阓担忧云客户成本支拨增速放缓,但公司对2027财年及长久增长充满信心。中枢驱能源来自智能体AI(Agentic AI)的爆发式演进,企业正从传统软件转向实时生成Token的AI模式,使得“算力即收入”。唯独Token生成需求抓续指数级增长,数据中心扩建与算力插足就不行或缺。

以下为事迹讲明会主要内容:

Q: 感谢采纳发问。你之前提到目下依然能看到2027财年的增长,贵公司的购买承诺在某种流程上也反应了这种信心。可是Jensen,我很敬爱,本年顶级云客户的云成本支拨接近7000亿好意思元,很多投资者惦记来岁很难连接保抓这一增长水平,并且对于部分客户来说,他们产生现款流的智商正在受到压缩。尽管你对公司的阶梯图和购买承诺尽头有信心,但如果客户的成本支拨不再增长,英伟达能否连接找到增长能源?

A: 我对他们现款流的增长充满信心,原因很纯粹。咱们当今依然看到了智能体AI(Agentic AI)的演进,以及智能体在寰球各地企业中的实用价值。因此,你会看到阛阓对规划产生了令东谈主难以置信的需求。在这个东谈主工智能的新世界里,算力就等于收入。莫得算力,就莫得主义生成Token;莫得Token,就莫得主义加多收入。当今在云办事提供商的器具平台之上开发智能体系统的企业和孤苦软件开发商(ISV)数目激增,我敬佩咱们正处于一个重要拐点。咱们正在产生具有盈利智商的Token,这些Token对客户来说是高效的,对云办事提供商来说亦然成心可图的。

纯粹的逻辑是,规划的本色依然调动。往时是在规划机上运行传统软件,每年有3000亿或4000亿好意思元的成本支拨;当今依然进入了东谈主工智能时期,为了生成Token,你需要宽绰的规划智商,这意味着数据中心的扩建将平直拉动他们的收入增长。

Q: 祝福本季度取得的优异数据。你谈到了对Anthropic的一些计谋投资,以及与OpenAI、英特尔、诺基亚、新念念科技等中枢伙伴的相助,彰着英伟达正处于悉数这个词行业的中心。你能谈谈这些投资说明的作用吗?你如何看待运用钞票欠债表算作一种器具,来进步英伟达在生态系统中的地位并参与这种增长?

A: 从根蒂上说,英伟达的中枢护城河即是咱们的生态系统,这亦然悉数东谈主垂青咱们业务的原因。世界上险些每一家初创公司齐在英伟达的平台和生态系统中责任。咱们存在于每一个云霄,每一个腹地数据中心,以及遍布寰球的旯旮规划和机器东谈主系统中。数以千计的东谈主工智能原生居品齐是建立在英伟达的基础之上。咱们领有极好的起始,咱们在构建悉数这个词东谈主工智能生态系统时,不管是谈话AI、物理AI、规划生物学、机器东谈主照旧制造业,咱们齐但愿全面参与。这对咱们来说是投资悉数这个词生态系统的绝佳契机。

今天,咱们的生态系统比以往任何时候齐要丰富。往时咱们主若是一家基于GPU的规划平台公司,但当今咱们是一家全面的东谈主工智能规划基础设施公司。咱们在各个层面齐领有规划平台,从底层规划、AI模子、集结到DPU,组成了完好的规划堆栈。每个生态系统齐有不同的堆栈需求,咱们但愿确保连接投资于此。因此,咱们的投资计谋高度聚焦于扩大和深化咱们在各大生态系统中的影响力。

Q: 集结开荒在悉数这个词数据中心竖立中所占的比例连接上升。到2026财年,你们的集结收入每个季度齐在终了同比增长。正如你们提到的第四季度的强盛增长,时时彩彰着收成于纵向膨胀和横向膨胀的集结居品组合。我铭刻旧年上半年,Spectrum-X以太网交换平台的年化收入大致在100亿好意思元傍边,旧年下半年这个数字可能上升到了110亿至120亿好意思元。Jensen,在检察你们的订单时,非常是行将推出的102T Spectrum 6交换平台和Spectrum-XGS,目下的开工率趋势如何?您展望本年会以若何的水平收官?

A: 咱们将我方视为一家东谈主工智能基础设施公司,这包含了CPU和GPU。咱们发明了NVLink手艺,将单个规划节点纵向膨胀(Scale Up)成一个巨大的规划数据架。咱们提供的是机架级规划机,而不是单纯的规划节点。随后,咱们使用Spectrum-X和InfiniBand对这种NVLink纵向膨胀系统进行横向膨胀(Scale Out)。此外,咱们还使用Spectrum-X Scale Across进行跨数据中心的膨胀。

{jz:field.toptypename/}咱们公开提供悉数集结架构,以便客户不错字据不同规模的需求夹杂搭配,将集结集成到他们定制的数据中心里。NVLink的发明给咱们的集结业务带来了巨大的推能源。每个机架有九个交换机节点,每个节点有两块芯片,将来密度还会更高,每个机架的交换节点数目尽头惊东谈主。咱们当今依然是世界上最大的集结公司。几年前咱们刚刚进入以太网交换领域,我认为咱们当今可能依然是寰球最大的以太网公司了。

Spectrum-X以太网对咱们来说是一个巨大的见效,但咱们对客户的需求保抓敞开格调。有些东谈主垂青InfiniBand的低蔓延和膨胀智商,有些东谈主则心爱基于以太网的数据中心。咱们通过东谈主工智能处理边幅膨胀了以太网功能。当你建立一个耗资100亿或200亿好意思元的东谈主工智能工场时,数据中心集结的有用性和运用率哪怕进出10%到20%,齐意味着极其宽绰的资金各异。因此,英伟达的集结业务正在快速增长,这归功于咱们在构建AI基础设施方面的超卓成果。

Q: 跟着定制化芯片(ASIC/拨入式架构)在大环境下的发展,Windows和Groq等边幅可能会添加特定于解码的处置决策。跟着英伟达日益暖和基于特定责任负载的定制芯片,咱们应该如何看待你们将来的手艺阶梯图?

A: 每个东谈主齐应该尽量减少或取消所谓的“拨入式(Dial-in)”定制架构。原因是,每次你越过一个定制接口,齐会加多不必要的蔓延和功耗。咱们对定制架构并不外敏,但在十足莫得其他遴荐的情况下,咱们才会尝试使用。如果你望望Grace Blackwell架构和Rubin架构,咱们使用巨大的光罩和有限的芯片封装,这大幅减少了架构交叉的数目。

定制架构的“税赋”时时体当今竞争敌手的架组成果低下上。东谈主们常说英伟达领有软件上风,但很难界定软件从那边运转,架构又从那边收尾。咱们的软件之是以强健,是因为底层架构极其出色。毫无疑问,由于咱们私有的架构假想,CUDA架构比现存的任何规划架构齐更高效,快乐飞艇app每瓦特能提供更高的性能。

对于Groq和低蔓延解码器,我会在行将到来的GTC大会上共享更多想法。简而言之,因为CUDA的存在,咱们的基础设施具备极强的通用性。咱们将连接确保悉数GPU在架构上向下兼容。这意味着今天为Blackwell优化的模子和软件堆栈,一样成心于Hopper和Ampere。这即是为什么A100在推出多年后依然进展出色的原因。架构兼容性使咱们能够在软件工程和优化上进行大规模投资,因为咱们知谈越过云霄、腹地和旯旮的悉数这个词装机基础齐将从中受益。咱们将运用Groq算作加速器来膨胀咱们的中枢架构,就像咱们当年用Mellanox膨胀NVIDIA集结架构一样。

Q: 我想长远探讨本年数据中心业务的环比增长预测。本季度数据中心环比增长越过100亿好意思元,而事迹指令似乎示意了本年将来的增长节拍。非常是当Rubin架构加放肆度填补阛阓空白时,您对此有何看法?Blackwell的环比增长依然有了相等大的加速,咱们是否应该期待Rubin也会出现访佛的爬坡斜率?另外,您认为2027财年游戏业务是否还能终了同比增长,照旧会面对更大的显存供应链压力?

A: 让我先从将来的收入节拍谈起。当你放眼全年时,咱们十足会连接大规模请托Blackwell架构,同期也会看到Vera Rubin架构进入阛阓。Vera Rubin是一个尽头优秀的架构,目下依然为不同客户的繁多订单进行了缠绵。天然当今详情Rubin鄙人半年的具体爬坡斜率还为时过早,但阛阓对其意思极其浓厚、需求极其昌盛。

咱们展望险些所稀有据中心客户齐会采购Vera Rubin,目下的问题只是咱们进入阛阓以及客户在数据中心完成测试的速率。对于游戏业务,尽管咱们但愿能有更多产能,但将来几个季度的显存供应如实会尽头病笃。如果到本年年底供应链情况有所改善,那么就有契机终了同比增长,咱们会抓续跟进并向阛阓反馈。

Q: 当今东谈主工智能的投资更多运转转向推理责任负载,你能谈一谈目下CUDA在这个阶段的蹙迫性吗?

A: 如果莫得CUDA,咱们根蒂无法进行刻下规模的推理规划。咱们几年前推出的TensorRT LLM软件栈仍然是寰球性能最高的推理系统。为了针对NVLink进行优化,咱们需要在CUDA之上发明新的并行算法,以分派推理责任负载并运用NVLink 72架构的团聚带宽。NVLink 72使咱们的每瓦性能进步了50倍,每好意思元性能进步了35倍,这是一个令东谈主难以置信的最先上风。

对于咱们的客户来说,推理应今就等于收入。智能体(Agent)产生代币(Token)的数目呈指数级增长。当智能体进行代码编写时,它不再只是生成几千个代币,因为多个智能体算作团队协同责任,运行时刻可能长达几小时。咱们需要以更高的速率进行推理。当你以极高的速率进行推理,且每个生成的代币齐平直换算成好意思元时,它就平直转机为了超大规模云规划厂商(CSP)的收入。

因为每个数据中心的电力齐是有限的(举例受限于100兆瓦或1吉瓦),是以领有最好每瓦性能的架构就等于领有了最高的创收智商。今天如果不投资于最先进的规划架构,就不行能终了收入增长。遴荐最好每瓦性能的架构,平直决定了客户的贸易成败。

Q: 对于恒久毛利率是否能防守在75%傍边的中期水平,咱们应该如何看待2027财年之后的供应链可意想性?在那之后,显存消费方面是否有新的鼎新,能让咱们对恒久利润率保抓信心?

A: 防守咱们毛利率最中枢的杠杆,履行上是抓续为客户提供代际性能飞跃。如果咱们不错提供显赫超越摩尔定律的每瓦性能,咱们就能防守高毛利率。这是最纯粹亦然最蹙迫的观点。

咱们之是以能保抓如斯快的迭代速率,是因为寰球对代币(Token)的需求正在呈指数级爆发。云霄运行了六年的旧GPU齐依然完全消耗,算力价钱正在高涨。当代软件开发所需的规划量正在纵脱增长。因此,咱们的策略是每年请托一个完好的全新东谈主工智能基础设施。本年咱们推出了六款新芯片,接下来的Rubin时期也将推出繁多新芯片。在每一代居品中,咱们齐死力于在每瓦性能和性价譬如面提供断层式的最先。咱们进行极点协同假想的智商,使咱们能够抓续为客户提供巨大的价值,这亦然咱们防守利润率的根蒂保证。

Q: 你们的一些客户正在探究建造天外数据中心。您认为这在目下的经济景象下有多大的可行性?跟着时刻的推移,情况会如何演变?

A: 目下的经济账并不合算,但跟着时刻推移情况会平静改善。天外中运营数据中心的边幅与地球判然不同。天外中有丰富的太阳能,空间无穷,并且环境颠倒爽直。可是天外中莫得空气流动,是以散热的唯独步调是传导散热,你需要制造相等宽绰的散热器。液体冷却彰着行欠亨,因为它太重且容易结冰。

天外中如实有很多规划问题需要处置。NVIDIA Hopper架构依然是世界上第一个进入天外的GPU。GPU在天外中的最好用例之一是超高辞别率成像。使用光学和东谈主工智能手艺,GPU不错规划不同角度的重投影,裁减图像杂音。在天外中平直处理这些宽绰的PB级成像数据,过滤掉无须信息,只把原理原理且有价值的数据发还地球,这比把悉数原始数据传回地球要高效得多。因此,东谈主工智能在天外领域将会有尽头原理原理的应用出息。

Q: 我想谈谈对于收入多元化的问题。Colette之前提到,超大规模数据中心客户占到了收入的50%以上,但全体增长是由其余客户群带动的。这是否意味着非超大规模客户增长更快?他们在作念与超大规模企业不同的事情吗?非超大规模客户在你们业务中所占的比例会越来越大吗?

A: 是的,咱们的前五大客户(通讯办事提供商和超大规模云提供商)目下约占总收入的50%。与此同期,咱们正在与极其多元化的公司相助,包括AI模子制造商、企业客户、超等规划中心以及主权AI边幅。非超大规模阛阓的确是一个增长尽头快的领域,咱们但愿领有来自寰球各地、九行八业的极点种种化的客户群体。

Jensen补充:这亦然咱们生态系统的中枢上风之一。咱们是唯独一个存在于每个云霄、每个旯旮规划开荒中的加速规划平台。咱们正在培植电信行业,将来的无线集结和基站齐将是东谈主工智能驱动的规划平台(如咱们的Arial平台)。险些每一个机器东谈主、每辆自动驾驶汽车齐在使用咱们的手艺。

CUDA具备极强的生动性,使咱们能够处置谈话、规划机视觉、机器东谈主、生物学和物理学等各种问题。客户群的种种性是咱们最大的护城河。此外,咱们与OpenAI、Anthropic、xAI、Meta以及宽绰的开源软件社区(如HuggingFace上的150万个AI模子)保抓着精致的相助伙伴磋议。悉数这些模子齐在NVIDIA CUDA上运行,这让咱们的平台极其易用且投资极其安全,从而进一步促进了客户结构的种种化。

Q: 往时一个季度有音讯称,NVIDIA有智商股东将Vera CPU算作孤悲凉置决策推向阛阓。Vera在咱们将来的架构演进中饰演着若何蹙迫的变装?这主若是由推理责任负载的激增照旧异构规划驱动的?

A: 我会在GTC大会上共享更多细节。在最高层面上,咱们对CPU作念出了与世界上其他厂商判然不同的架构决策。Vera是唯独援救LPDDR5的数据中心CPU,旨在专注于极高的数据处明智商。

咱们暖和的大多数规划问题齐是数据驱动的。在东谈主工智能的悉数这个词规划管线中,你在进行预进修之前必须进行宽绰的数据处理;而在进修之后,刻下的东谈主工智能正在学习如何使用各种器具。很多器具完全运行在纯CPU环境中,或带有GPU加速的CPU环境中。Vera被假想成一款颠倒优秀的“后进修(Post-training)”CPU。当你把算法加速到GPU的极限时,字据阿姆达尔定律(Amdahl‘s Law),你会需要一个单线程性能极高的CPU。这即是为什么咱们将Grace打形成单线程性能超卓的居品,而将来的Vera在这一丝上将进展得愈加名满世界。

Q: 对于成本部署,你们展望本年将产生粗陋1000亿好意思元的现款。不工作迹多好,近期股价似乎并莫得大幅高涨。你们是否认为目下是一个很好的价钱位置,不错进行大规模的股票回购?为什么不插足大齐资金进行回购呢?

A: 咱们尽头仔细地谛视咱们的成本答复策略。咱们认为目下最蹙迫的事情之一是全力援救咱们眼前宽绰的生态系统和供应链。咱们需要插足资金以确保将来的产能供应,并在早期开发阶段为平台上的AI处置决策开发者提供赋能。这是咱们计谋投资中极其蹙迫的一环。天然,咱们仍在进行股票回购并防守股息披发。咱们将在年内连接寻找私有的阛阓契机来扩充这些成本竖立。

Q: Jensen,您之前概述过,到2030年数据中心成本支拨可能达到3万亿至4万亿好意思元,这意味着将来的增长率将会大幅加速。股东这种体量退换的重要应用门径是什么?是物理AI、智能体AI照旧其他手艺?您对这个3-4万亿好意思元的预测规模仍然充满信心吗?

A: 是的,咱们完全不错通过基本面来推演这个预测。最先,将来软件的运行边幅是东谈主工智能驱动的,中枢在于生成代币(Token)。以NVLink 72为例,它使咱们生成代币的能效比上一代进步了50倍。代币生成险些是将来悉数规划的中枢。

往时寰球每年在传统规划上投资约3000亿到4000亿好意思元,但这只是是提前录制和预编译软件的需求。当今东谈主工智能的规划需求比往时高出千倍。因此,目下7000亿好意思元的成本支拨远远不及以本心寰球生成代币的宽绰需求。每家公司、每个软件齐将依赖AI生成代币,这即是我所说的“东谈主工智能工场(AI Factory)”。

往时咱们开发软件是事先写好的,就像刻录DVD一样;而当今,一切齐是字据用户的高下文、意图实时生成的。这种Agentic AI(智能体AI)所需的算力规模是传统规划无法相比的。因为悉数的云公司最终齐由软件驱动,这种算力平直转机为了他们的真金白银。

在往时的两三个月里,智能体AI依然迎来了一个确凿的爆发拐点。不管是Cloud Code、OpenAI Codex照旧Cursor,代码生成智能体的需求呈指数级增长。像Anthropic这么的公司,收入在一年内增长了10倍,但依然受限于算力瓶颈。在刻下的新世界中,推理即是收入,算力即是收入。这种新的规划范式不行逆转。在智能体AI之后,下一个爆发的拐点将是物理AI(Physical AI),咱们将把东谈主工智能带入制造业和机器东谈主领域,这将开启一个愈加宽绰且圆润东谈主心的万亿级阛阓契机。

XG云数智轮廓整理

海量资讯、精确解读,尽在新浪财经APP

海量资讯、精确解读,尽在新浪财经APP

包袱裁剪:高佳